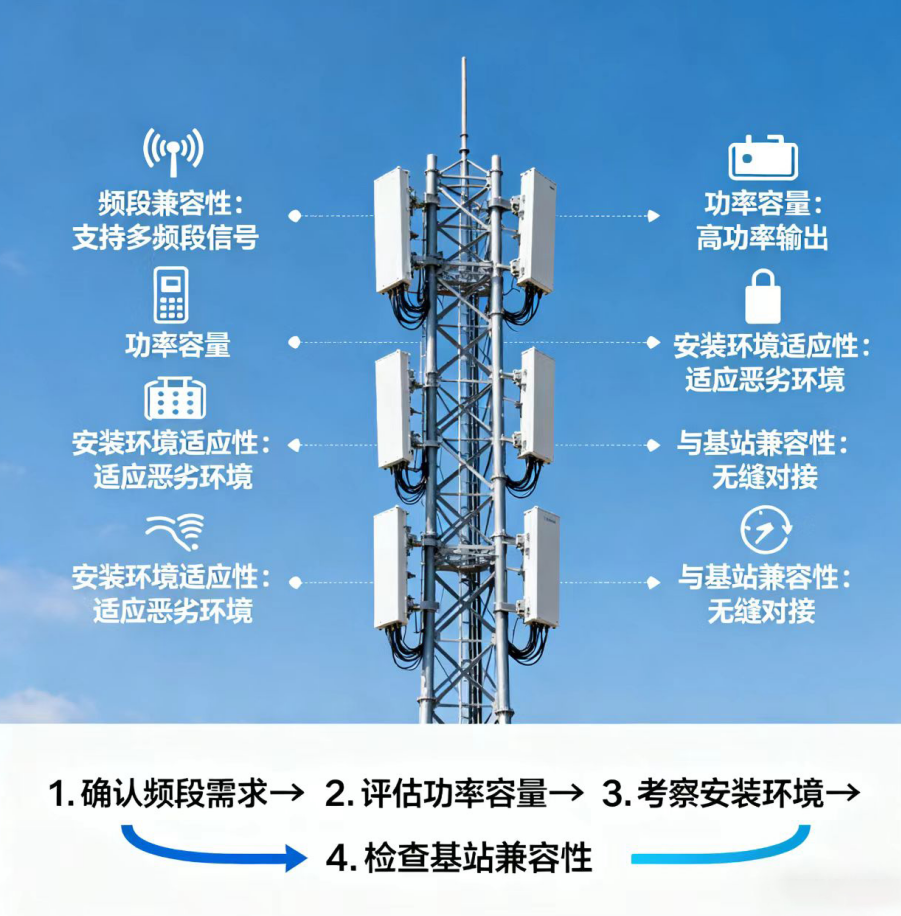

Dopasowanie impedancji i zgodność z pasmem częstotliwości

Dlaczego wartość 50 Ω jest kluczowa dla interfejsów RF stacji bazowych?

Systemy stacji bazowych (BTS) w znacznym stopniu zależą od utrzymania standardowego impedancji 50 om na całym obszarze swoich interfejsów RF. Dzięki temu można maksymalnie wykorzystać przenoszoną moc i jednocześnie ograniczyć uciążliwe odbicia sygnału. Międzynarodowe normy inżynierii RF, takie jak IEC 61196 i IEEE 1162, rzeczywiście określają to wymaganie, zapewniając poprawne współdziałanie anten, filtrów, wzmacniaczy oraz długich linii transmisyjnych, które wszyscy znamy i lubimy. Gdy różnice impedancji przekraczają zakres ±5 om, od 15 do 30 procent mocy nadawanej odbija się z powrotem zamiast zostać przesłaną w odpowiednim kierunku. Tego rodzaju zjawisko znacząco pogarsza jakość sygnału i powoduje problemy z pomiarami współczynnika fali stojącej napięcia (VSWR). A przyznajmy sobie szczerze: w dzisiejszych sieciach komórkowych działających na niezwykle wysokich częstotliwościach nawet niewielkie odchylenia nasilają się w miarę propagacji przez system. Dlatego ścisłe przestrzeganie standardu 50 om nie jest już tylko dobrym zwyczajem – jest to konieczność, jeśli chcemy, aby nasze wdrożenia sieci pozostawały stabilne i możliwe do skalowania w razie potrzeby.

Wymagania dotyczące wydajności w zakresach HF/VHF/UHF oraz zakresach komórkowych (700 MHz–2,7 GHz)

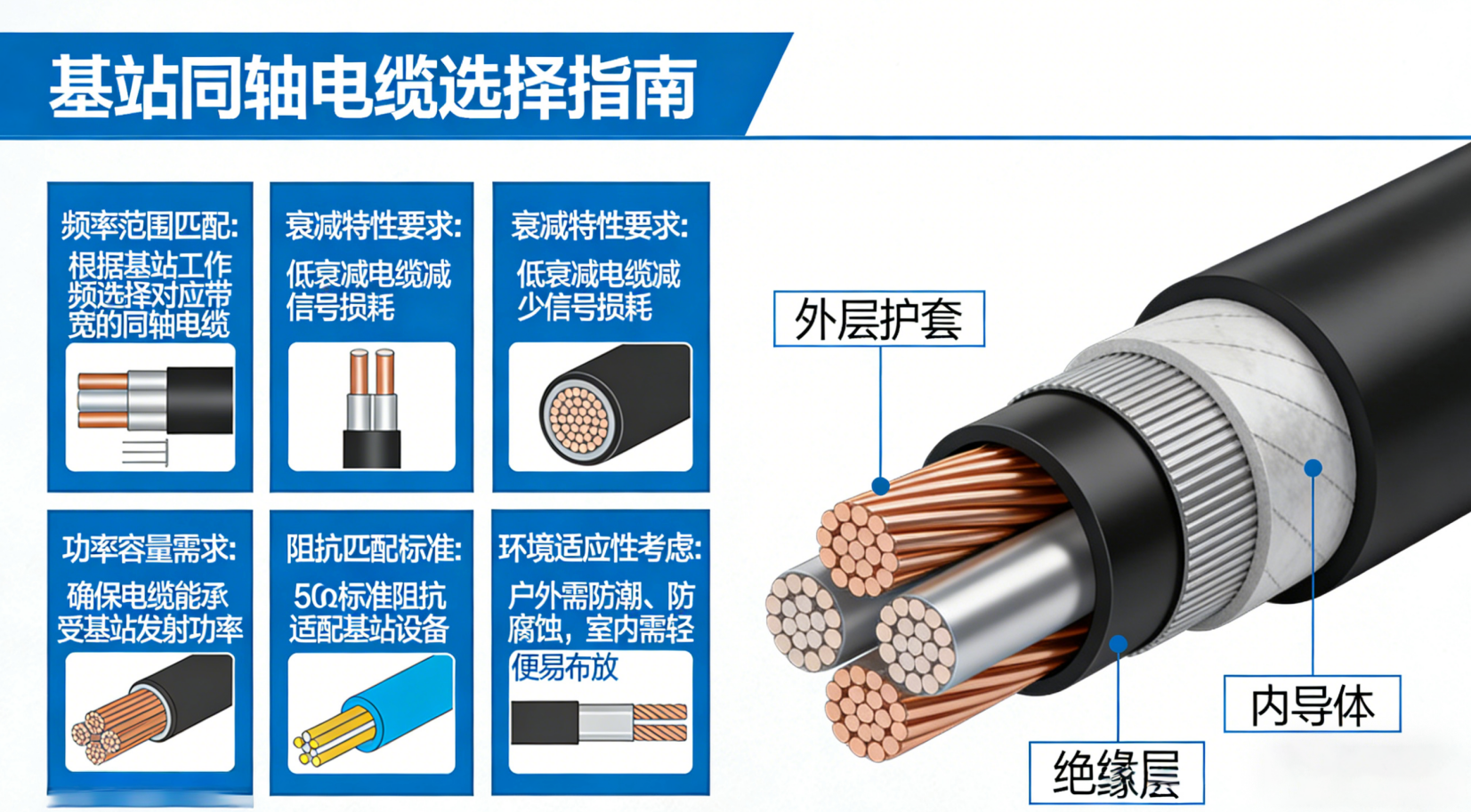

Aby kable koncentryczne działały prawidłowo, muszą utrzymywać stałą impedancję 50 om w całym zakresie swojego działania, a także dobrze funkcjonować w określonych pasmach częstotliwości. Przy analizie częstotliwości HF i VHF w zakresie od około 3 do 300 MHz najważniejsze jest utrzymanie stabilnych charakterystyk fazowych oraz minimalizacja rozproszenia sygnału. Jest to szczególnie istotne w przypadku starszych systemów nadal wykorzystujących analogowe komunikacje głosowe oraz dziedziczne metody transmisji danych. Sytuacja znacznie się zmienia przy przejściu do zakresu UHF oraz współczesnego widma komórkowego, obejmującego częstotliwości od ok. 700 MHz aż do około 2,7 GHz. W tym zakresie kluczowe staje się ograniczanie tłumienia sygnału oraz zapewnienie, że kabel jest w stanie wytrzymać wysokie poziomy mocy. Dotyczy to zwłaszcza obecnych sieci 5G, które wymagają tak szerokich pasm przepustowości oraz skomplikowanych konfiguracji masowych MIMO. Ciekawostką jest fakt, że kabel zaprojektowany specjalnie do pracy przy częstotliwości 2,7 GHz może ulec utracie mocy sygnału o około 40 procent więcej niż identyczny kabel używany przy częstotliwości zaledwie 700 MHz. Ze względu na tę znaczną różnicę inżynierowie muszą szczególnie zwracać uwagę na takie czynniki jak rodzaj materiałów dielektrycznych, kształt przewodników oraz rodzaj ekranowania stosowanego w trakcie produkcji, jeśli chcą zachować jakość sygnału w całym zakresie częstotliwości, w którym te kable są eksploatowane.

Wpływ współczynnika odbicia fal (VSWR) na niezawodność systemu w gęstych rozmieszczeniach stacji bazowych (BTS)

W przypadku gęstych obszarów miejskich lub lokalizacji, na których wiele operatorów dzieli przestrzeń, każda wartość współczynnika VSWR przekraczająca 1,5:1 zaczyna znacząco obniżać niezawodność systemu. Analiza rzeczywistych pomiarów wykonanych w terenie przez główne sieci operatorów ujawnia niepokojącą tendencję: gdy współczynnik VSWR utrzymuje się na poziomie powyżej 1,8:1, liczba awarii stacji wzrasta o około jedną czwartą. Główne przyczyny to energia odbita zakłócająca odbiorniki kierunku wstępnego oraz powodująca te uciążliwe, automatyczne wyłączenia nadajników, których nikt nie chce. Dodatkowo, jeśli kable koncentryczne lub łączniki nie są prawidłowo dopasowane, powstaje tzw. pasywna intermodulacja (PIM). Ta PIM zakłóca sąsiednie kanały i sprawia, że wykorzystanie widma staje się mniej efektywne, niż powinno być. Inna ważna kwestia, którą inżynierowie powinni mieć na uwadze: ponieważ współczynnik VSWR sumuje się w sposób kumulacyjny przez poszczególne komponenty połączone szeregowo – np. kable skokowe, następnie główne linie zasilające, a na końcu anteny – utrzymanie każdego punktu połączenia poniżej wartości 1,25:1 jest równie istotne jak kontrola samego współczynnika przy nadajniku. Takie szczegółowe podejście do wszystkich interfejsów zapewnia stabilną pracę całego łańcucha komunikacyjnego.

Kompromisy związane z tłumieniem sygnału, wytrzymałością mocy i fizycznymi wymiarami

Tłumienie kabla koncentrycznego w funkcji częstotliwości, długości i średnicy: Dane rzeczywiste dla pasm BTS o częstotliwościach 146 MHz oraz 1,8–2,7 GHz

Straty sygnału w kablu koncentrycznym podlegają dość przewidywalnym wzorom. Gdy częstotliwość podwaja się, straty rosną czterokrotnie. Jeśli ktoś zmniejszy średnicę kabla o połowę, należy spodziewać się około 30% większej degradacji sygnału, szczególnie w zakresach częstotliwości komórkowych, które obecnie budzą naszą szczególną troskę. Weźmy pod uwagę standardowe kable o średnicy pół cala na długości 100 metrów: przy częstotliwości 146 MHz tracą one około 3,2 dB mocy sygnału. Jednak gdy częstotliwość zwiększymy do 2,7 GHz, straty gwałtownie wzrastają do 18 dB – wartość ta znacznie przekracza dopuszczalny próg dla sieci 5G (zwykle poniżej 1,5 dB na 100 stóp). Grubsze kable, takie jak 7/8 cala lub nawet 1-5/8 cala typu heliax, pozwalają ograniczyć te straty poniżej 6 dB przy częstotliwości 2,7 GHz na tej samej odległości, co wspiera utrzymanie silnego zasięgu na obrzeżach komórek. Istnieje jednak pewien haczyk: większe kable są bardzo sztywne i trudne w montażu, zwłaszcza na masztach, gdzie miejsce jest ograniczone. Ponadto instalatorzy muszą poświęcić dodatkowy czas i środki finansowe na prawidłowe prowadzenie takich kabli. A oto jeszcze jedna kwestia, o której nikt nie lubi mówić, ale która ma ogromne znaczenie: każda dodatkowa strata 3 dB sygnału wymaga podwojenia mocy nadajnika, aby zapewnić prawidłowe funkcjonowanie systemu. Strat sygnału nie można więc traktować wyłącznie jako problem związany z częstotliwościami radiowymi – wpływają one także na zarządzanie ciepłem oraz generują rzeczywiste trudności operacyjne dla operatorów sieci.

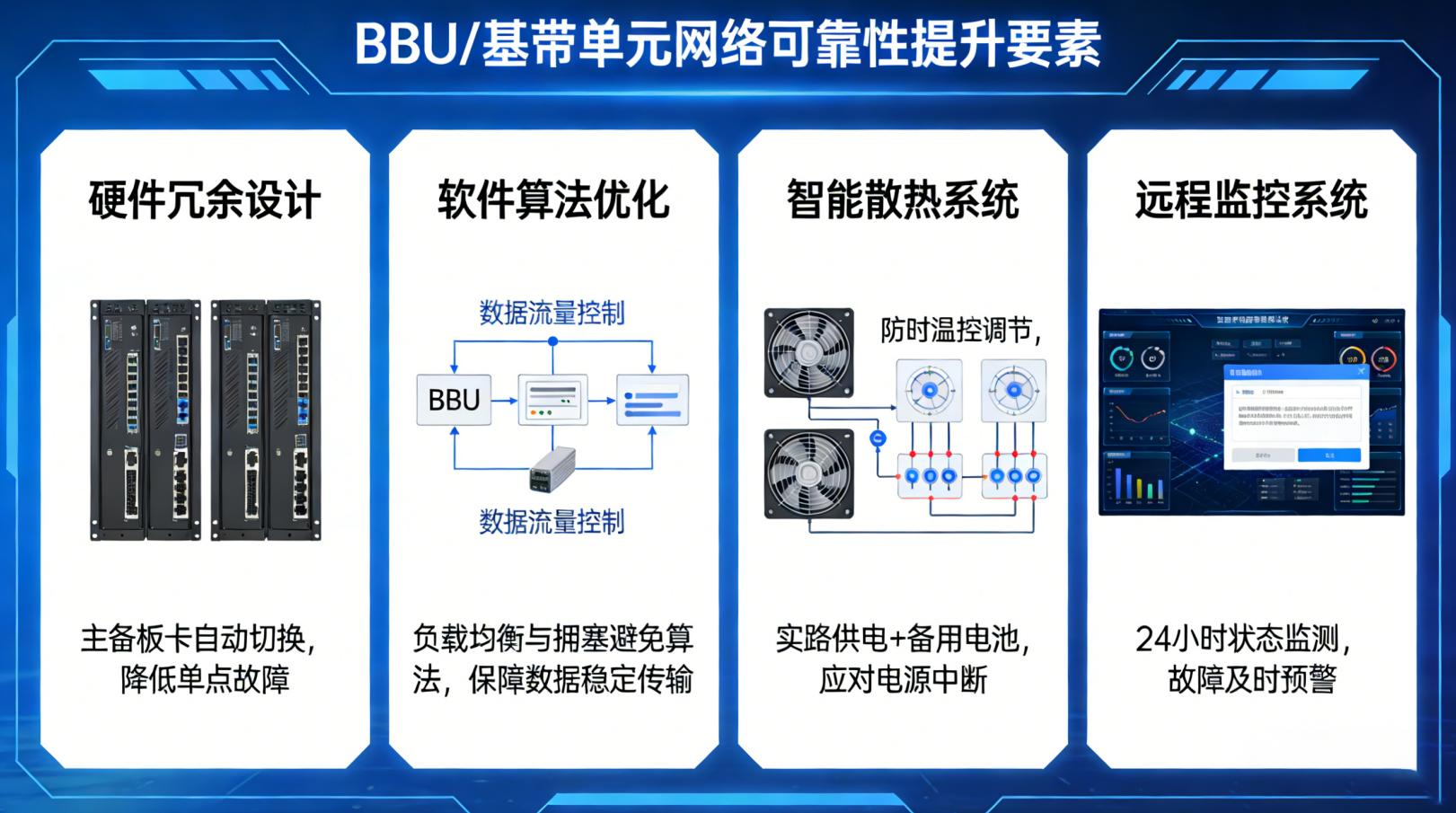

Uwagi dotyczące zarządzania temperaturą i mocy znamionowej dla nadajników BTS o mocy od 100 W do 1000 W

W przypadku zastosowań stacji bazowych BTS o dużej mocy obsługę mocy nie można oddzielić od skuteczności odprowadzania ciepła. Problemem kabli o dużych stratach jest zamiana znacznej części energii RF na ciepło. Weźmy na przykład sygnał ciągły o mocy 100 W pracujący na częstotliwości 2,1 GHz. Taki układ może faktycznie podnieść temperaturę zewnętrzną standardowego kabla koncentrycznego o średnicy pół cala o około 15 °C, co przyspiesza proces starzenia się materiału dielektrycznego w jego wnętrzu. W przypadku makrostanowisk pracujących z mocą 1000 W, gdy temperatura otoczenia przekracza 40 °C, operatorzy muszą obniżyć wyjściową moc o około 40%, aby zapobiec całkowitemu uszkodzeniu izolacji. Skuteczne zarządzanie termiczne obejmuje stosowanie kabli z falowaną powłoką miedzianą, ponieważ odprowadzają one ciepło około o 25% szybciej niż ich odpowiedniki z gładką powłoką. Istotne jest również ścisłe przestrzeganie minimalnego promienia gięcia, aby uniknąć powstawania uciążliwych „gorących punktów” w określonych miejscach. Wszystkie te kroki pomagają wydłużyć żywotność sprzętu oraz utrzymać stabilny poziom zakłóceń PIM, szczególnie w trakcie długotrwałego użytkowania przy wysokich obciążeniach mocy.

Porównanie typowych kabli koncentrycznych stosowanych w instalacjach stacji bazowych (BTS)

Kable koncentryczne serii RG vs. kable koncentryczne LMR®: analiza tłumienności, giętkości i kosztów przy kluczowych częstotliwościach

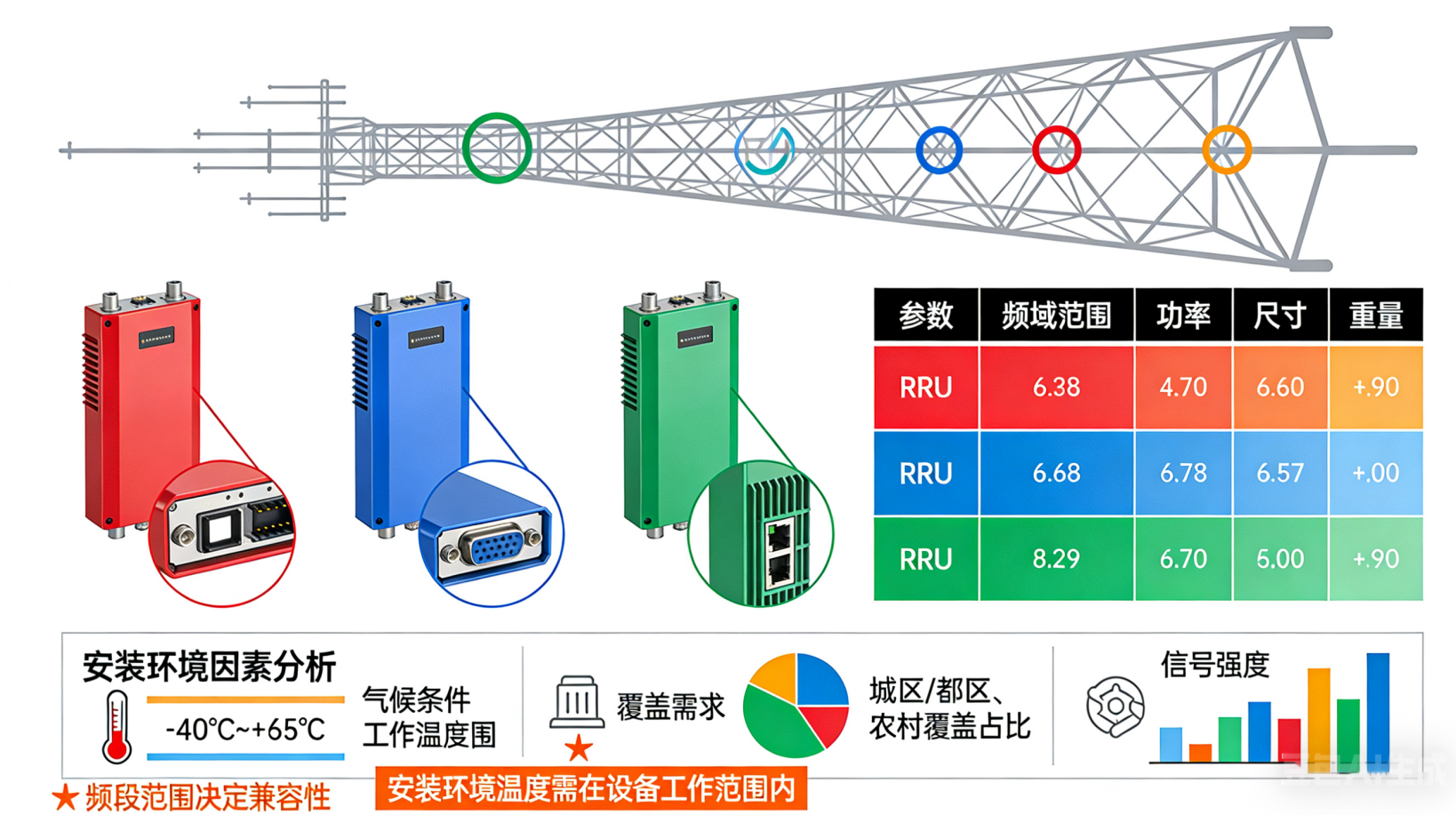

Wybór odpowiedniego kabla koncentrycznego do instalacji BTS wymaga uwzględnienia kilku czynników, w tym strat sygnału, odporności na obciążenia mechaniczne, trwałości w warunkach zewnętrznych oraz kosztów eksploatacyjnych w dłuższej perspektywie czasowej. Przy pracy w typowym zakresie częstotliwości komórkowych – od ok. 700 MHz do ok. 2,7 GHz – kable serii RG, takie jak RG6 i RG11, są początkowo tańsze, kosztując mniej więcej o 30–50% mniej niż ich odpowiedniki z serii LMR. Istnieje jednak pułapka: kable te wykazują znacznie większe tłumienie sygnału na długości linii. Na przykład kabel RG6 tłumiący około 6,9 dB na 100 stóp (ok. 30,5 m) przy częstotliwości 2,5 GHz, podczas gdy LMR 400 tłumiący jedynie ok. 3,9 dB na tej samej długości. Różnica ta nabiera szczególnej wagi przy długich trasach kablowych, typowych dla makrostanowisk, ponieważ bezpośrednio wpływa na obszar zasięgu oraz zwiększa ryzyko wystąpienia zakłóceń. Innym aspektem do rozważenia jest elastyczność. Kable LMR wyposażone są w faliste ekranowanie miedziane oraz gładkie powłoki polimerowe, co umożliwia im wykonywanie ostrzejszych zakrętów. LMR 400 może być gięty z minimalnym promieniem zakrętu wynoszącym zaledwie 1,25 cala (ok. 3,18 cm), podczas gdy RG11 wymaga promienia o minimalnej wartości 3 cali (ok. 7,62 cm). Różnica ta ma kluczowe znaczenie podczas montażu w ciasnych przestrzeniach, gdzie wiele anten jest umieszczanych blisko siebie, zapobiegając uszkodzeniom spowodowanym nadmiernym gięciem, które mogłyby prowadzić do awarii w przyszłości.

| Parametr | RG6 (50 Ω) | RG11 (50 Ω) | LMR®400 (50 Ω) |

|---|---|---|---|

| Tłumienie @ 2 GHz | 6,5 dB/100 ft | 4,8 dB/100 ft | 3,3 dB/100 ft |

| Maksymalna moc przeznaczona do przesyłania | 1,1 kW | 1,8 kW | 2,4 kw |

| Promienie zakrętu | 3" | 4" | 1.25" |

Kable serii RG nadal dobrze sprawdzają się w przypadku krótkich odcinków wewnątrz budynków lub gałęzi systemów DAS, jednak gdy chodzi o zewnętrzne linie zasilające stacje bazowe (BTS), które są narażone na trudne warunki środowiskowe, kable LMR wyraźnie się wyróżniają. Kable te wytrzymują skrajne temperatury od −55 °C do +85 °C, odporność na uszkodzenia spowodowane promieniowaniem UV oraz zapewniają dobre parametry wydajności PIM na poziomie typowo −150 dBc. Odporność na warunki atmosferyczne ma ogromne znaczenie, ponieważ takie linie są stale narażone na wilgoć i działanie promieni słonecznych w warunkach zewnętrznych. Uwzględnienie zwrotu z inwestycji również ma sens. Większość inżynierów stwierdza, że wyższe początkowe koszty zakupu kabli LMR opłacają się w dłuższej perspektywie czasowej — sygnały pozostają silniejsze przez dłuższy czas, konieczność wymiany występuje rzadziej, a technicy spędzają mniej czasu na usuwaniu awarii w przyszłości w porównaniu do taniej na pierwszy rzut oka alternatywy.

Trwałość środowiskowa i integracja łączników dla zewnętrznych lokalizacji stacji bazowych (BTS)

Odporność na promieniowanie UV, odporność na zmiany temperatury oraz materiały powłok zapewniające bezpieczeństwo przed interferencjami PIM (polietylen, LSZH i falisty miedziany płaszcz)

W przypadku zastosowania na zewnątrz kable koncentryczne BTS codziennie stają przed różnorodnymi wyzwaniami środowiskowymi. Wymienić można tu intensywne działanie promieni słonecznych, skrajne wahania temperatur – od mroźnych nocy po gorące dni, przedostawanie się wody przez mikroskopijne pęknięcia oraz ciągłe tarcie o powierzchnie. Dlatego też wielu instalatorów wybiera powłoki polietylenowe ze względu na ich doskonałą odporność na promieniowanie UV. Materiały te zachowują elastyczność nawet przy temperaturach poniżej zera stopni Celsjusza lub znacznie przekraczających temperaturę ciała człowieka – co sprawdza się doskonale w większości instalacji na masztach komórkowych. W miejscach, gdzie zagrożenie pożarem jest szczególnie duże – np. wewnątrz budynków lub pod ulicami miast – konieczne są specjalne wersje o niskim dymieniu i bezhalogenowe. Ograniczają one emisję niebezpiecznych gazów w razie awarii. Nie należy także zapominać o metalowej osłonie znajdującej się wewnątrz tych kabli. Samego zastosowania wysokiej jakości powłoki nie wystarczy. Aby poziom pasywnych intermodulacji pozostawał znacznie poniżej -140 dBc, niezbędna jest odpowiednia falista osłona miedziana. Jest to szczególnie istotne dla sieci 5G, ponieważ w przeciwnym wypadku zakłócenia mogą całkowicie zatrzeć słabe sygnały lub zakłócić komunikację sterującą. Wybór odpowiedniej kombinacji zewnętrznego pokrycia i wewnętrznej osłony ma ogromny wpływ na czas użytkowania tych kosztownych komponentów – zwłaszcza w pobliżu oceanów, gdzie sól zawarta w powietrzu powoduje korozję, czy też w zakładach przemysłowych narażonych na działanie agresywnych chemikaliów.

Złącza typu N, 7/16 DIN oraz 4.3-10: granice częstotliwości, momenty dokręcania i wydajność pod względem intermodulacji

Złącza pełnią funkcję zarówno połączeń elektrycznych, jak i barier chroniących przed czynnikami zewnętrznymi; ich jakość ma istotny wpływ na ogólną niezawodność całego systemu. Weźmy na przykład złącza typu N. Pracują one z sygnałami o częstotliwości do ok. 11 GHz i są powszechnie stosowane w sprzęcie pomiarowym oraz w niskoprądowych przewodach przejściowych. Istnieje jednak pewien warunek – aby zapewnić odporność na wodę (stopień ochrony IP67) oraz utrzymać stabilne połączenie o impedancji 50 omów, należy dokręcić je z odpowiednią siłą momentu obrotowego, wynoszącą od 15 do 20 niutonometrów. W przypadku mocywnych nadajników makrobazowych, generujących moc 500 watów lub więcej, inżynierowie zazwyczaj wybierają złącza 7/16 DIN. Te urządzenia charakteryzują się lepszą odpornością na zakłócenia (do -155 dBc – co jest bardzo dobrym wynikiem) oraz obsługują sygnały o częstotliwości do 7,5 GHz. Ich wada? Duża wielkość czyni je nieodpowiednimi do zastosowania w ciasnych obudowach małych komórek sieciowych. Pojawia się też nowszy typ złącza – 4,3–10 – zaprojektowany specjalnie dla potrzeb wdrożenia technologii 5G. Złącze to wyjątkowo skutecznie tłumi sygnały niepożądane (czy ktoś słyszał o wartości -162 dBc?), działa stabilnie przy częstotliwości 6 GHz i dzięki swojej kompaktowej konstrukcji dobrze wpasowuje się w ciasne przestrzenie, bez zagrożenia powtarzalności połączeń. Niezależnie jednak od tego, które złącze zostanie zainstalowane, prawidłowe doborowanie momentu dokręcania ma kluczowe znaczenie. Zbyt luźne dokręcenie umożliwia przedostawanie się wody, co prowadzi do korozji. Zbyt silne dokręcenie natomiast powoduje uszkodzenia wewnętrzne – np. wygięcie środkowego pinu lub uszkodzenie ekranowania – co negatywnie wpływa na jakość pomiarów sygnału (VSWR przekracza wartość 1,5:1) oraz generuje liczne problemy z niezawodnością w dalszej części systemu.

Najczęściej zadawane pytania

Jakie jest znaczenie impedancji 50 om w interfejsach RF stacji bazowych (BTS)?

Utrzymanie impedancji 50 om jest kluczowe w interfejsach RF stacji bazowych (BTS), aby zoptymalizować przenoszenie mocy i zmniejszyć odbicia sygnału. Zapewnia to zgodność i niezawodność pomiędzy różnymi komponentami, takimi jak anteny, wzmacniacze i linie transmisyjne, zgodnie ze standardami międzynarodowymi, takimi jak IEC 61196 i IEEE 1162.

W jaki sposób współczynnik stojącej fali napięcia (VSWR) wpływa na niezawodność systemu w gęstych rozmieszczeniach stacji bazowych (BTS)?

Współczynnik VSWR wyższy niż 1,5:1 może znacznie obniżyć niezawodność systemu, szczególnie w gęstych obszarach miejskich. Wysokie wartości VSWR powodują wzrost energii odbitej, prowadząc do awarii lokalizacji oraz pasywnych intermodulacji, które negatywnie wpływają na efektywność wykorzystania widma. Stałe monitorowanie i utrzymywanie poziomów VSWR poniżej 1,25:1 we wszystkich punktach połączenia jest niezbędne do zapewnienia stabilnej pracy systemu.

Jakie są kompromisy między rozmiarem kabla koncentrycznego a jego wydajnością?

Większe kable koncentryczne mogą zmniejszać tłumienie sygnału, ale ze względu na ich sztywność są trudniejsze w montażu. Mniejsze kable są łatwiejsze w obsłudze, ale mogą wymagać wyższej mocy nadajnika w celu pokonania dodatkowych strat sygnału, co wpływa na zarządzanie temperaturą i funkcjonowanie systemu.

Dlaczego kable LMR są preferowane w zewnętrznych instalacjach stacji bazowych (BTS)?

Kable LMR są preferowane w zewnętrznych instalacjach stacji bazowych (BTS) ze względu na ich doskonałą odporność na promieniowanie UV, dużą elastyczność oraz niższe tłumienie sygnału w porównaniu do kabli serii RG. Choć początkowo są droższe, kable LMR zapewniają lepszy zwrot z inwestycji dzięki ograniczeniu problemów eksploatacyjnych oraz dłuższemu okresowi bezawaryjnej pracy w trudnych warunkach środowiskowych.

Spis treści

- Dopasowanie impedancji i zgodność z pasmem częstotliwości

- Kompromisy związane z tłumieniem sygnału, wytrzymałością mocy i fizycznymi wymiarami

- Porównanie typowych kabli koncentrycznych stosowanych w instalacjach stacji bazowych (BTS)

-

Trwałość środowiskowa i integracja łączników dla zewnętrznych lokalizacji stacji bazowych (BTS)

- Odporność na promieniowanie UV, odporność na zmiany temperatury oraz materiały powłok zapewniające bezpieczeństwo przed interferencjami PIM (polietylen, LSZH i falisty miedziany płaszcz)

- Złącza typu N, 7/16 DIN oraz 4.3-10: granice częstotliwości, momenty dokręcania i wydajność pod względem intermodulacji

-

Najczęściej zadawane pytania

- Jakie jest znaczenie impedancji 50 om w interfejsach RF stacji bazowych (BTS)?

- W jaki sposób współczynnik stojącej fali napięcia (VSWR) wpływa na niezawodność systemu w gęstych rozmieszczeniach stacji bazowych (BTS)?

- Jakie są kompromisy między rozmiarem kabla koncentrycznego a jego wydajnością?

- Dlaczego kable LMR są preferowane w zewnętrznych instalacjach stacji bazowych (BTS)?